近日,多名配音演员相继公开发声,反对未经演员知情同意,擅自采集其声音素材用于AI训练、音色合成及商业变现的行为。

有评论认为,目前,AI仿声侵权已经形成了一条“素材采集-内容生成-流量变现”的灰色产业链。同时,AI仿声侵权比AI换脸更隐蔽,维权难度更大。配音演员的声音是如何被“偷走”的?维权难,难在哪里?又该如何破局?

从《甜蜜蜜》里的黎小军,到《无间道》中的刘建明,配音演员叶清塑造了经典的人物形象。就在不久前,短视频平台上出现了一集AI生成的短剧,许多观众通过弹幕刷屏:主人公的旁白是“叶清老师的声音”。

短视频平台上出现了一集AI生成的短剧,许多观众通过弹幕刷屏:主人公的旁白是知名配音演员叶清老师的声音

3月21日晚在接受记者采访时,叶清坦言,AI短剧里对他的音色还原度极高。

叶清表示:“旁白就是我的声音,我一听表达方式(又不对),就是如果我面对这种文字,我就不会这样去说,但是它又实实在在是我的声音在说这个话,那就变成我被迫要接受这不是我的意愿,但是用我的声音去演绎的作品。这些东西没有经过任何许可,就让我们的声音可能遍布满大街,或者人家会觉得这个价值就没有了。”

类似的经历在配音行业中屡见不鲜。配音导演、配音演员李龙滨也经常成为这种侵权行为的受害者。

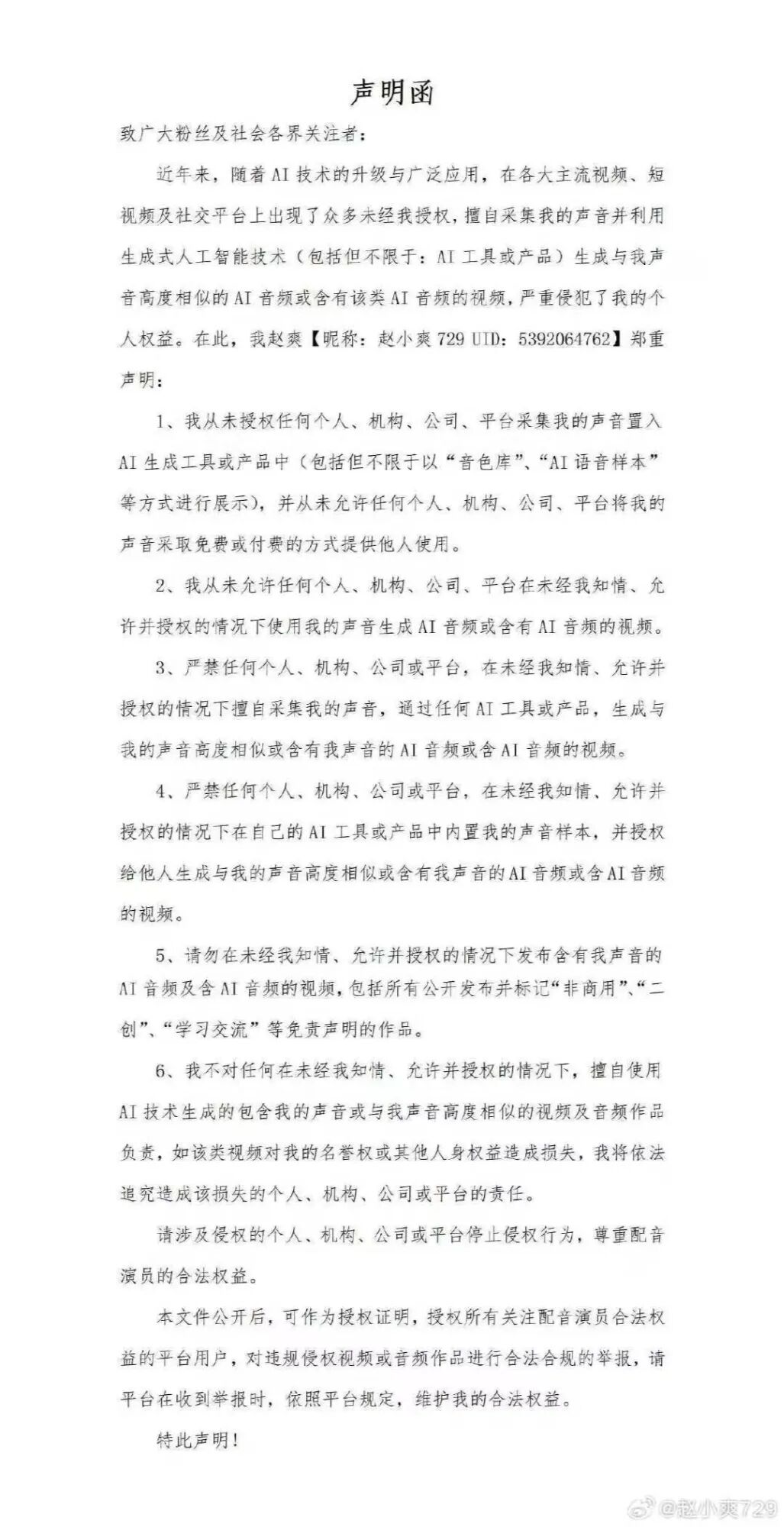

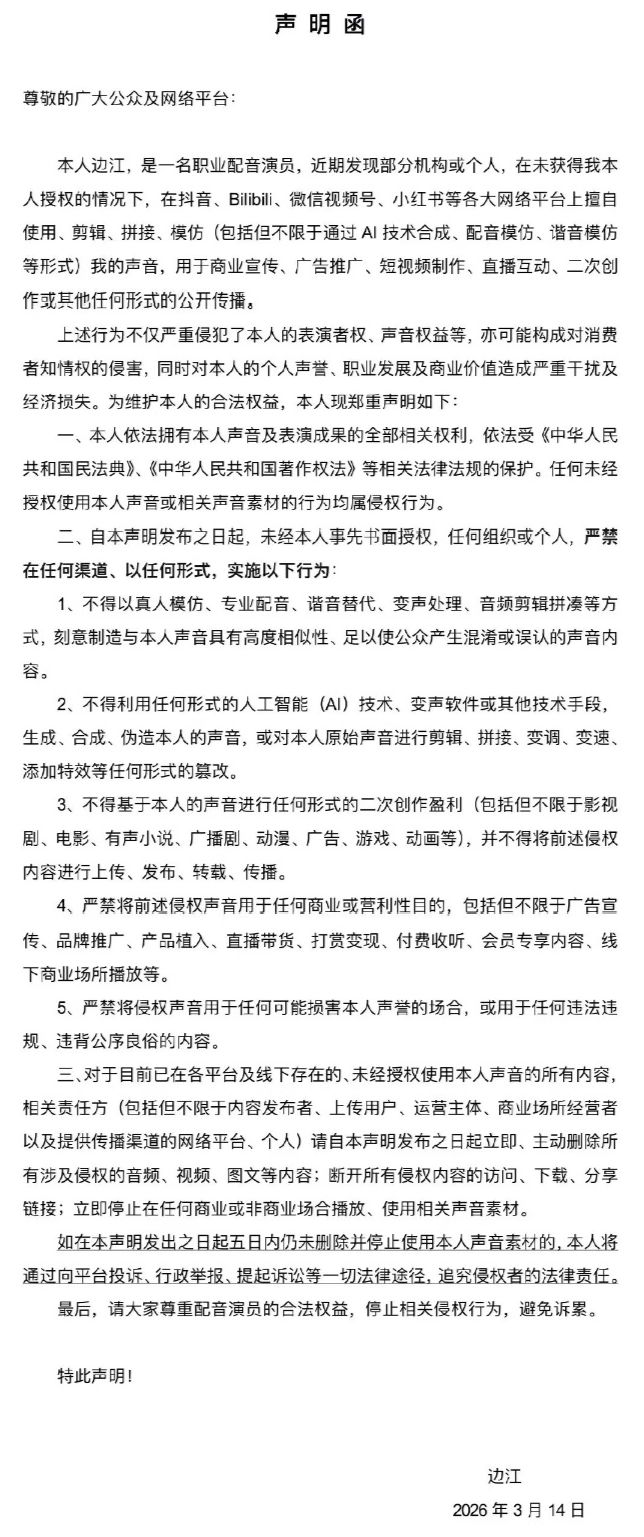

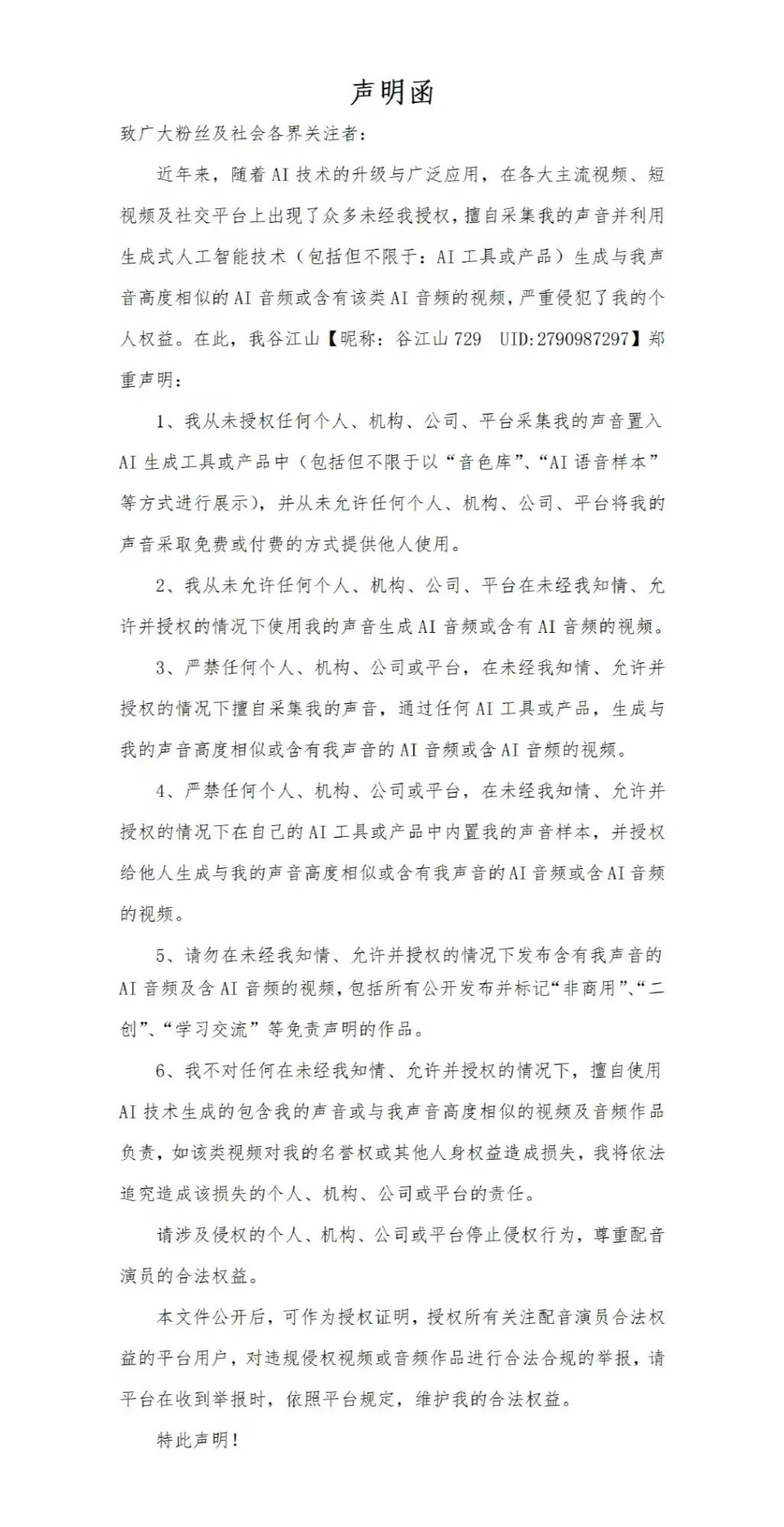

多名配音演员相继公开发声,反对未经演员知情同意,擅自采集其声音素材用于AI训练、音色合成及商业变现的行为

李龙滨讲述:“经常会有朋友发过来,说龙滨老师这是你的声音吗?我听一下,真的很像。尤其短的、手调之后,我觉得相似度能达到百分之九十以上了。比如我配张家辉的《激战》里边的场面,经常会被AI,而且它改完词之后二创,有时候连我自己都要仔细分辨一下。”

未经授权的AI仿声,对配音演员和整个行业带来前所未有的冲击。季冠霖曾为《甄嬛传》《疯狂动物城》等知名影视作品配音,她认为,在艺术层面上,无序发展的AI仿声消解着配音演员的表演能力和情感流动。在一个魔改印度版甄嬛传中,季冠霖的声音被仿,在她本人听来,虽然声音很像,但角色不像。

季冠霖说:“我们每一个配音演员,在录制每个角色的时候,真的是在用自己流动的情感以及这么多年的生命体验去工作的,这跟AI生成不一样。如果未来没有更多的演员愿意在声音塑造上做事情的话,那就不可能再有新的素材。没有新的素材,AI就永远在旧的素材里无限循环。”

多名配音演员相继公开发声,反对未经演员知情同意,擅自采集其声音素材用于AI训练、音色合成及商业变现的行为

季冠霖认为,未经授权的AI仿声除了降低配音行业应有的艺术水准和价值之外,还会让配音演员面临诸多法律风险。

季冠霖进一步说:“它可能会说很多过分的语言,甚至是违背公序良俗的语言,最害怕的是未来有没有可能它用我的声音生成一段违法、行骗的语音,或者是一个虚假广告。这些如果被生成了,那我们怎么去界定它是AI还是我本人?”

针对未经授权的AI仿声带来的行业与个人困境,法律层面是如何界定的?中国政法大学人工智能法研究院院长张凌寒表示,一方面,可能侵犯配音演员的声音人格权,还可能侵犯相关影视剧作品的著作权。

张凌寒讲述:“从法律角度看,未经授权采集声音素材是违反了民法典的相关规定。根据我国法律,对于声音的保护,参照于肖像的保护,没有经过权利人的同意,有可能对权利人的声音权利也就是人格权益造成侵害。如果说相关的声音是从有关的影视作品片段或者是声音素材当中采集出来的,也有可能侵犯了相关权利人的著作权。”

多名配音演员相继公开发声,反对未经演员知情同意,擅自采集其声音素材用于AI训练、音色合成及商业变现的行为

然而,多位业内人士及法律专家认为,在实践中,如何认定AI仿声侵权、如何去监管,目前有现实的难题。首先是取证链条弱。叶清认为,网络传播的 AI 语音多为碎片化二次加工,难以追溯源头、固定完整侵权链路。

叶清说:“一般情况下,要找一些点击率比较高的视频,才有维权的价值。找到视频发布者的信息很难,律师花了很长的时间,可能持续一年,才找到第一个(侵权人)的信息。而且同行里还有取证的问题,你怎么证明这个声音就是你的?那可能要声纹鉴定,其实也是耗时耗力的。”

此类维权的另一个难点是“鉴定”难。不同于能看得见、摸得着的肖像权,声音没有实体,听得到、抓不住,容易被剪辑、篡改、变速,对于配音演员来说,切换多种声线更是工作常态,在此基础上,AI微调音色、语调等就可以做到高度相似但非1:1复刻。

李龙滨表示:“因为这些年他们采集了非常多人的声纹,有足够多的声纹素材,会把这些声纹捏在一起,会让人觉得像你又不像你。这就跟水墨画一样,掺的比例不同,你很难界定,在技术上去维权非常难。”

多名配音演员相继公开发声,反对未经演员知情同意,擅自采集其声音素材用于AI训练、音色合成及商业变现的行为

张凌寒表示,训练数据不透明,被侵权人难以证明数据来源,因此,追责面临不小的困难。

张凌寒进一步说道:“侵权行为的判定,并不要求声纹百分之百对比一致,而只要有可能造成公众混淆,就达到了侵权损害要件的构成要件。更重要的是对于AI声音侵权,追责是比较难的,因为侵权方可能会说,我是从公开网站上采集的各种各样的身份信息,很难说它就是采取了这样一个侵犯著作权的行为。”

那么,该如何探索AI技术与配音行业的合法共存模式?叶清认为,首先声音使用方应正视法律问题,通过合规的手段取得授权并恰当使用AI仿声技术。

叶清表示:“行业现在面临着AI的很多问题,这也是一个趋势。比如你的声音音色比较好,你的表达方式或者说话方式是别人比较喜欢的,那你去跟你的合作者谈,是真人去演绎,还是说用你的AI。比如你想用我的声音去念辞海,那我要念好多年我才能念完,但如果念辞海是一个标准化的语气,那我只要提供我的音色就可以了。你认可这种表演,包括制作方也认可,这个作品才是有保障的。”

中国政法大学知识产权中心特约研究员赵占领认为,行业自律与平台规则同样是构建合规生态的重要一环。

赵占领表示:“目前,司法实践的经验还不是很充分,需要积累做判断。在监管政策还没有出台的情况下,网络平台、AI软件平台可以要求和禁止用户未经授权使用他人声音进行AI生成。”

多位受访者还呼吁,未来希望通过加水印等技术手段,为AI声音搭建可追溯、可识别的安全框架。

“比如AI声音中的水印如何嵌入,这需要一个统一的规范技术标准。在配音行业中,高质量有商业价值的声音相对来说不那么多。对于这样的配音演员,是不是可以把自己的声音和声纹进行单独备案,以便将来更好追责。相信有了相关的判定之后,随着监管制度、标识制度和取证制度的逐步完善,对于配音演员声音有效的保护机制能够迅速建立起来。”张凌寒说。

原标题:《多位知名配音演员,对“AI仿声”进行集体维权》

栏目主编:顾万全

文字编辑:宋慧

本文作者:央广网

题图来源:上观题图